Suntem în 2019 și cuvinte ca inteligența artificială (AI) sau algoritmi trebuie să facă partea din descrierea oricărui produs software, pentru a fi inovativ, trending sau disrupting. Într-o combinație de româno- engleză de salon mai punem un pic de blockchain și un vârf de lingurița de tehnologii emergente.:D

Dar dincolo de buzz-ul de marketing (uneori neacoperit de practică), automatizarea proceselor software devine o activitate curentă pentru din ce în ce mai multe business-uri (chiar discutam azi cu Alin Popescu, în contextul scopului viitoarei conferințe Future Zone pe care o face Avocatnet.ro). Unii dezvoltă astfel de automatizări, dar din ce în ce mai multe le implementează (fie ca SaaS, fie on-premise... sau mixt).

Subiectul ridică suficiente probleme de etică și obiectivitate (aspecte pe care și eu le învăț în acest context), dar și de viitoare reglementare a AI sau a algoritmilor. Însă înainte de a vorbi despre reglementări viitoare (de care nici nu sunt sigur că e nevoie), este momentul să discutăm despre ceea ce avem deja reglementat - zona de date personale și GDPR si cum se aplică pe zona de algoritmi și AI.

Un document de lucru publicat zilele trecute de Grupul de la Berlin, care practic merge mai în detaliu de la declarația Conferinței Autorităților de Protecție a Datelor (2018) sumarizează două capitole majore legate de privacy & AI. Înainte de a rezuma cele două capitole, ar trebui să nu uităm că pericolele nu vin de la AI sau algoritmi în sine (sau măcar nu acum), ci de la programatorii care le scriu sau la firmele care cer le configurează sau fac anumite implementări.

1. Care sunt zonele unde AI poate interacționa cu datele personale?

- folosirea de date personale în procesul de antrenarea/învățare algoritmică

- aplicarea AI către date personale (capitol în care dacă decizia are efecte juridice sau efecte semnificative, ne gândim la art 22 din GDPR)

- folosirea AI pentru extragerea de date personale din date care nu par să conțină astfel de informații; inclusiv posibilitatea de re-identificare a persoanelor

2. Care sunt pericolele pentru viața privată ale folosirii incorecte a AI?

- discriminare și subiectivism;

- colectarea de date en-gros în loc de reducerea la minimum a datelor (art 5 GDPR)

- modificarea scopului prelucrării datelor;

- lipsa de transparența și înțelegere a ceea ce face AI cu datele tale, având ca una din consecințe și imposibilitatea unui consimțământ informat;

- analiza datelor care duc la re-identificarea persoanelor vizate sau identificarea unor aspecte legate de date din categorii speciale.

Dincolo de AI & date personale

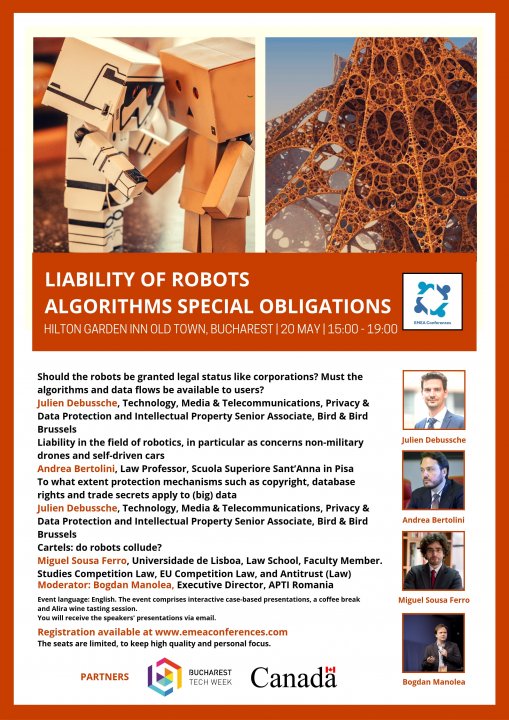

Dacă ați ajuns până aici cu textul e bine să extindem scopul, pentru că subiectul AI și algoritmi are o serie de valențe juridice dincolo de partea de protecția datelor - de la reponsabilitate (sau exonerarea de responsabilitate) în contextul dezvoltării unor astfel de soluții până la aspecte de proprietate intelectuală (drepturi de autor? drept sui-generis?) asupra algoritmilor, dar și al rezultatelor acestora. Cu privire la aceste probleme, mărturisesc că încă am mai multe întrebări decât răspunsuri, dar știu că la evenimentul organizat de Emeaconferences de pe 20 mai care atinge aceste subiecte vin 3 specialiști europeni, cu mai mare expertiză decât a mea. Găsiți o prezentare în imaginea de mai jos. Dacă mă simt mai luminat după eveniment, mai pun o postare. Până atunci, dacă vreți să-i întrebați voi problemele voastre concrete, vă puteți înscrie cu un discount de 10% dacă folosiți codul Trusted.Ro. :)